用惯了云端 AI 服务的人,大概很难想象在自己的笔记本上跑一个 7B 参数的大模型是什么体验。Ollama 做到了。

它不是又一款”AI 产品”,而是一个面向开发者的本地模型运行环境。你不需要懂 CUDA、不需要配 Docker,直接一条命令把模型拉下来跑。Llama 3、Qwen、Mistral、Gemma……主流开源模型基本都支持。

为什么开发者值得关注

云端 AI 的问题在于两件事:一是数据隐私,你和 AI 对话的内容会不会被用来训练,谁也说不准;二是网络延迟,尤其是国内访问海外服务,不稳定是常态。

本地模型把这两个问题同时绕过去了。你的代码、你的对话、你的业务逻辑,全都在本地处理,不出机器一步。更重要的是,一旦跑起来,它是真的快——没有网络往返,延迟只取决于你的 CPU 和内存。

上手有多简单

macOS 直接用 Homebrew 安装:

brew install ollama然后跑一个模型,比如 Mistral:

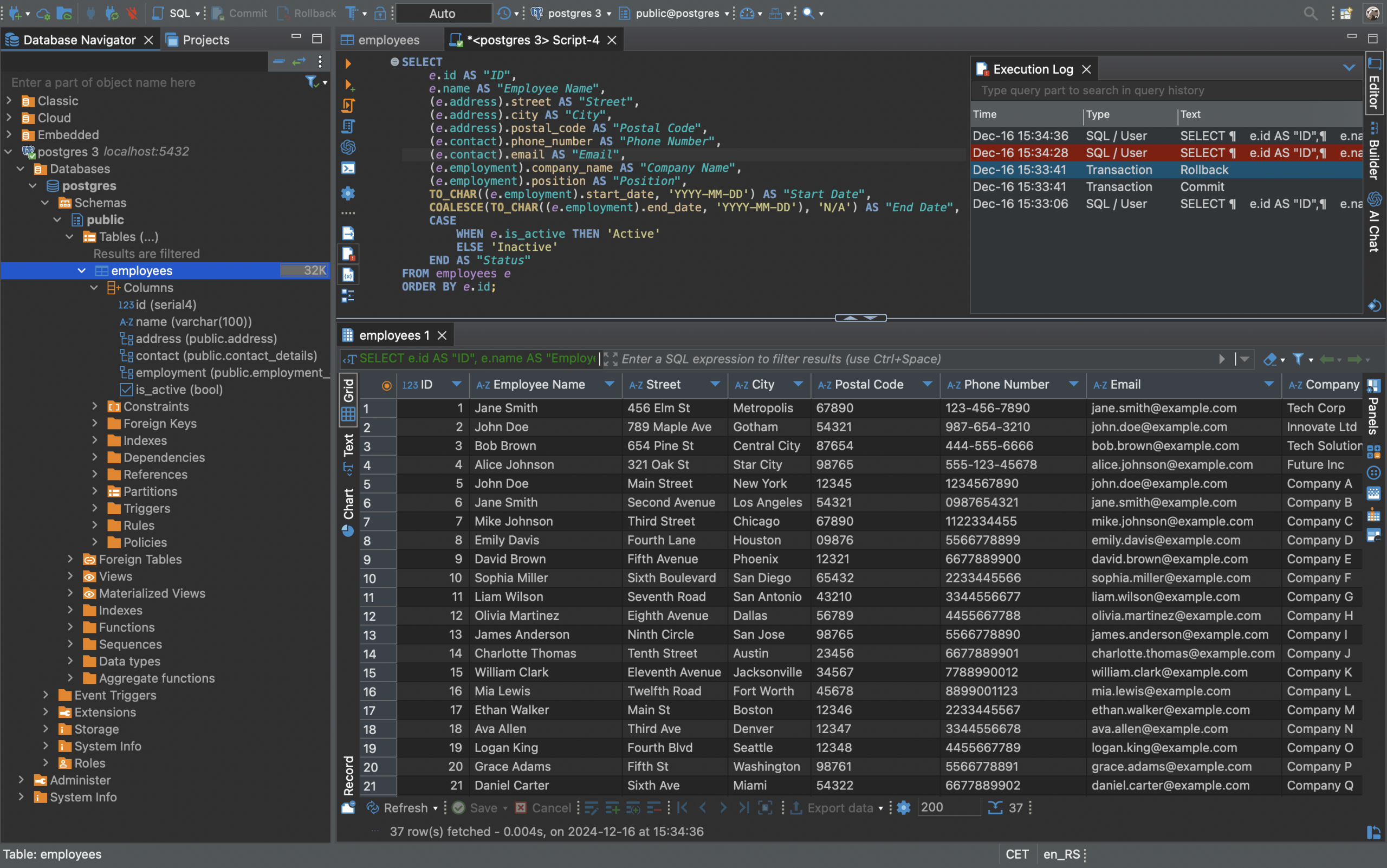

ollama run mistral第一次运行会自动下载模型文件,之后就本地加载。跑起来之后,你可以用 REST API 调用它,跟调用 OpenAI 的方式几乎一样:

curl http://localhost:11434/api/generate -d "{\"model\": \"mistral\", \"prompt\": \"用 Python 写一个快速排序\"}"够简单了吧。

它能用来做什么

我个人的用法是这样:把 Ollama 和 Continue(或 Cline)集成到 VS Code 里,给 AI 一个项目级的上下文,让它在本地帮我审查代码、生成测试用例、解释陌生的模块逻辑。

效果最明显的是代码审查这个场景。本地模型跑在私域数据上,不用担心代码泄露,响应速度也够快。7B 的 Mistral 跑在我这台 MacBook Pro 上,每秒大概能吐出二三十个 token,足够用来读懂一段代码并给出建议。

资源占用怎么样

这大概是大家最关心的问题。7B 模型在 MacBook Pro(M 系列芯片)上大概占用 4-5GB 内存,跑起来不卡。14B 模型需要 8-10GB,16B 以上基本要 16GB 起步。

所以实际建议是:7B 和 14B 的模型是目前主流用法,量化版本(Q4_K_M)可以显著降低内存占用,代价是略微牺牲一点模型质量。

跟云端 AI 比怎么样

坦率说,本地模型的推理能力跟 GPT-4、Claude 这种顶级闭源模型比,还有差距。尤其是复杂推理和多步逻辑,本地模型偶尔会卡壳。

但差距在缩小,而且本地模型有自己的优势:完全免费、无网络依赖、数据隐私。对于日常的开发辅助(写工具函数、查文档、解释代码、生成测试),体验已经非常接近云端服务了。

总结

Ollama 解决的是一个真实的开发痛点:如何在保证效率的同时,保护自己的数据不被上传到第三方。它的上手成本极低,配置一条命令,模型就跑起来了。如果你的工作涉及代码相关的内容,强烈建议花 10 分钟跑起来试试。

暂无评论内容