最近「AI 会取代我们吗?」这个问题困扰着很多人。LLM 写代码的水平已经到了中高级,这让很多工程师开始担心自己的未来。

说实话,这篇文章我重写了好几遍,比平时花的时间多很多。我不想站队「AI 无用论」,那不是我的看法。我每天工作都在用 LLM,已经很难想象没有它们怎么干活了——不是因为没有 LLM 我就不会写代码,而是效率会低很多。

AI 进化得比大多数工程师适应得还快,整个 IT 行业正在经历深刻变革。因此很多人感到压力、抵触、甚至敌意。但这些情绪大多不是真正的威胁驱动的,而是 AI 厂商的营销和 hype 在推波助澜。

这篇文章的目的不是要说 AI 很弱或者没有用。完全不是。我要说的是另一面——LLM 是强大的工具,但它们有局限,而且需要懂得自己在做什么的专业人士来驾驭。

AI 在软件开发中的现状

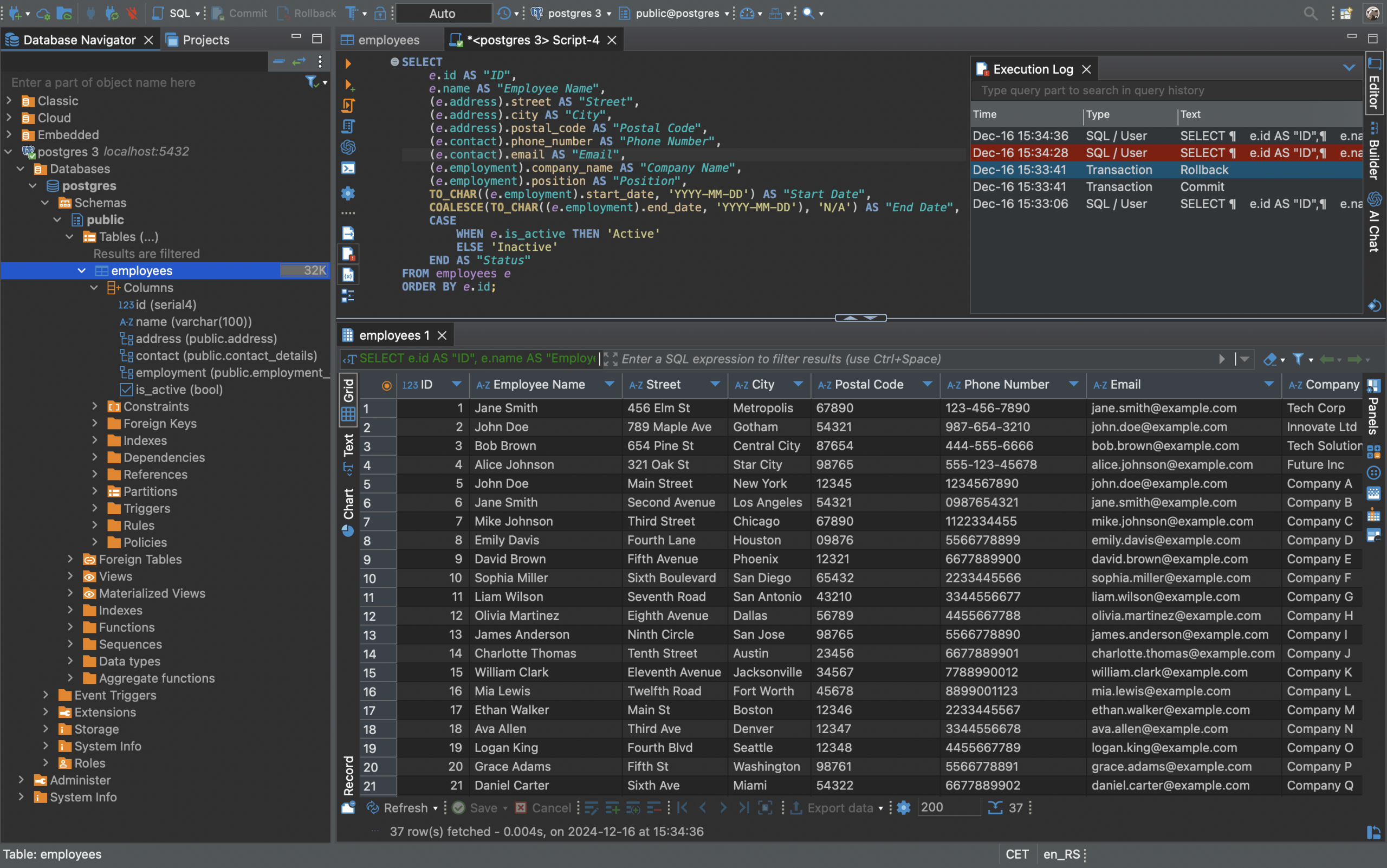

现代 LLM 确实是强大的开发工具。Claude Code 或 Codex 能写出高质量、结构良好、相当复杂的代码,能处理大型代码库并理解项目上下文。

要判断 AI 未来能否取代软件工程师,先要回答一个核心问题:LLM 真的理解为什么需要这段代码吗?

如你所知,LLM 的原理是基于海量训练数据,预测最可能的 token 序列延续,说白了,AI 不是在「思考」,也不理解系统的目标。它只是在统计层面决定接下来最可能写什么。

这就是为什么 LLM 在典型和定义清晰的任务上表现出色:

CRUD 应用、标准 REST API、基于 Angular 或 React 的简单 SPA、模板化业务逻辑。这些内容在训练数据里出现次数太多了,模型能够自信地复现熟悉的模式。

问题出现在需要深层领域理解和执行上下文时。比如设计一个有严格容错、数据一致性和业务约束要求的分布式系统。在这类任务中,AI 生成的代码看起来可能「干净」且正确,但:

- 没有考虑真实负载场景

- 破坏了重要的业务逻辑规则

- 或者提出了在当前环境下根本无法工作的架构方案

系统越复杂、上下文越宽、请求越不形式化,模型出错、幻觉或走向错误方案的概率就越高。

模型 scaling 解决不了根本问题

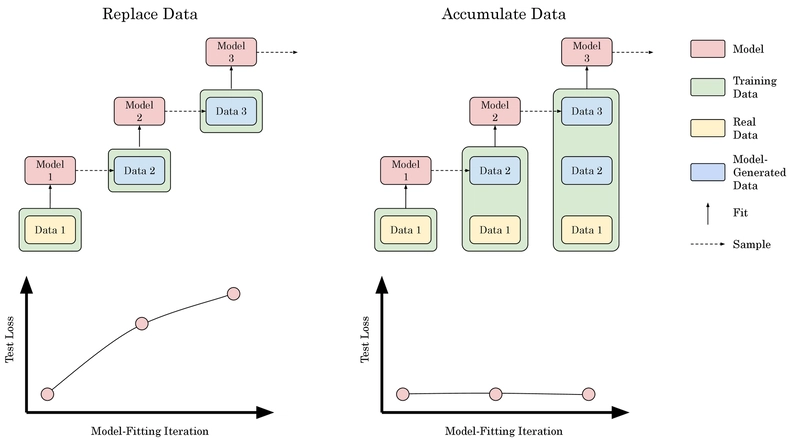

训练数据质量是构建更强大 LLM 的最大挑战之一。即使不断 scale 模型,模型崩溃(Model Collapse) 问题也会限制进展。当模型在已经包含 AI 生成内容或低质量数据上训练时,它们会开始放大错误、重复失误或学习不真实的模式。单纯把模型做大解决不了根本问题,基础本身需要干净可靠。

图灵奖得主、现代 AI 创始人之一、Meta 前首席 AI 科学家 Yann LeCun 认为,单纯增大 LLM 的规模和力量是没有帮助的。在他看来,这不是通往真正 AGI 的道路。

他认为真正的智能需要模型理解物理世界、因果关系和目标。仅靠语言是不够的:

「我们需要理解物理世界的系统,而不是只会生成看似合理文本的系统。」

编程需要规划、推理和理解长期后果。LLM 能帮助写代码,但它们不能真正设计系统,也不能理解解决方案为什么有效。因此,无论新模型多强大,同一个根本问题始终存在。

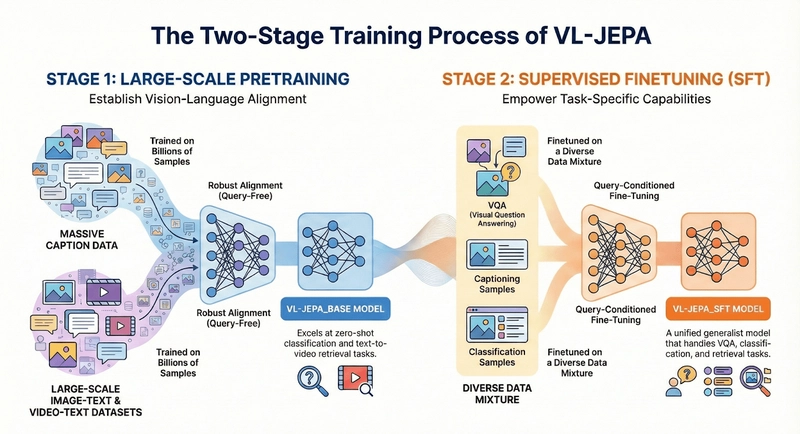

与此同时,Yann LeCun 正在研究一种新的 AI 架构——VL-JEPA(Vision-Language Joint Embedding Predictive Architecture)。这不是 GPT 那样的经典生成式方法。模型在语义表征层面工作,不是逐 token 预测文本,而是预测答案的「语义指纹」。如果需要,这个表征可以后续解码成文本。

VL-JEPA 在分类、视频理解、视频搜索和视觉问答等任务上可能比传统多模态模型更高效,因为不需要为每个任务单独训练模型。

2025 年最糟糕的趋势:Vibe Coding

「vibe-coding」这个词在 2025 年 2 月出现,OpenAI 联合创始人在 X 上发帖说这是用自然语言和完全信任 AI 来写代码的好方法,代替传统手动编程。然后 hype 就炸了。只要你跟 AI 对话,它就能做你大学学了几年、练习了多年的事情。

营销非常强。很多 IT 圈外的人开始自己搭 Web 服务。有人甚至把程序员辞了——花 20 美元订阅就能搞定一切,何必花更多钱?过了一段时间,问题开始暴露:API key 提交到公开仓库、网站安全漏洞、一晚上烧了 300-400 美元(token 用太多)。有些应用直接挂了。

如果你觉得这只是新手才会犯的错,咱们再深入看看。

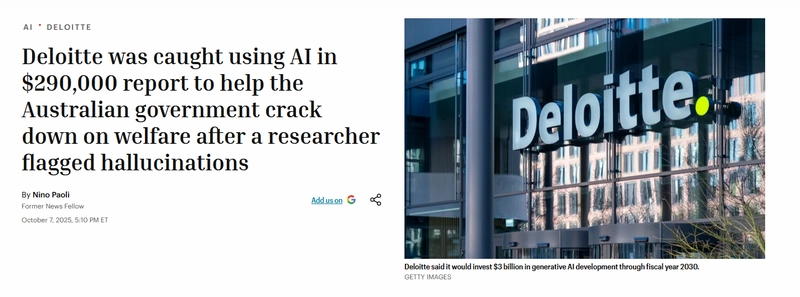

你可能听说过 2025 年夏天,德勤卷入了一个丑闻。他们为澳大利亚政府提交的报告部分由 ChatGPT 生成,里面引用了不存在的法律和虚假事实。公司面临经济和声誉双重损失。这可是全球级别的公司,在这种公司报告要过很多部门和审批,但还是出事了。

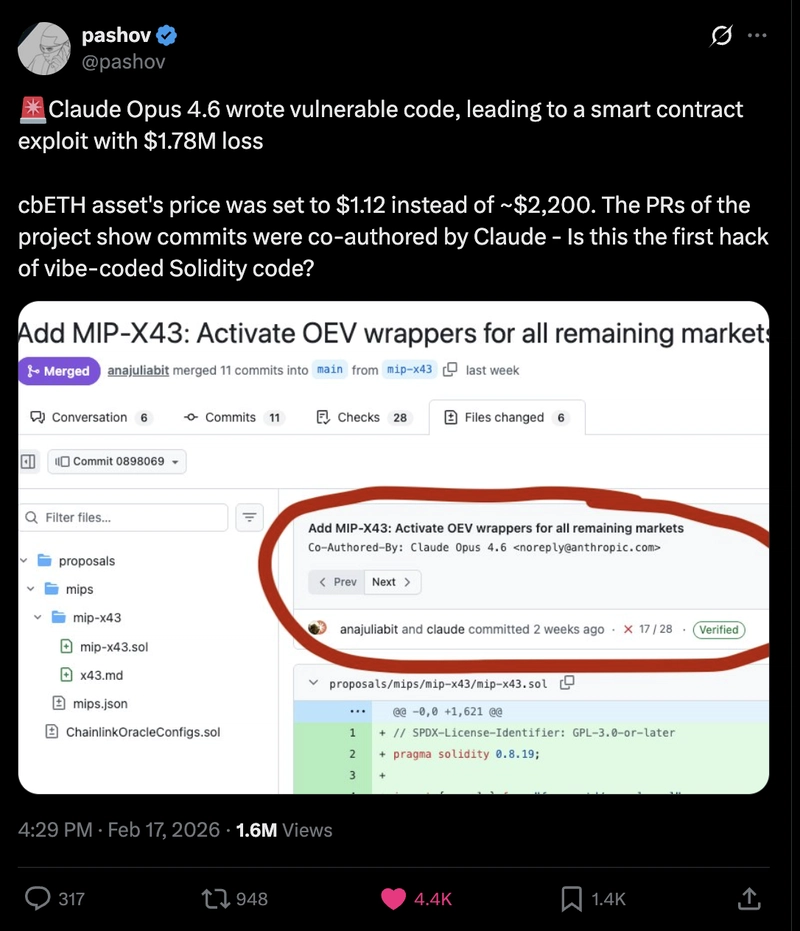

另一个案例发生在 2026 年 2 月。DeFi 协议 Moonwell 发布了新更新,随后系统开始把代币 cbETH 定价为约 $1.12,而其实际市场价格约为 $2,200。

问题出在智能合约逻辑里的一个基本计算错误。虽然 Moonwell 团队在四分钟内就修复了这个 bug,但协议仍然损失了约 170 万美元。

而这个漏洞的提交是用 Claude Code 生成的。当然,把责任全推给 AI 是不公平的——开发者在推送之前确实审核了代码。但审核不够彻底,对「game-changing」模型信任过度。

关键结论: 无论 LLM 生成的代码看起来多干净、多可靠,你都应该始终批判性思考,考虑边界情况。

vibe coding 拿来验证个人项目的想法没问题,但对于大型复杂系统,vibe coding 靠不住。

AI Agent——程序员的替代品?

继「vibe coding」之后的第二个 hype 词是「AI agent」。它和普通 AI 有什么区别?自主性。Agent 可以规划行动、评估自己的成果。与简单的 ChatGPT 对话不同,Agent 可以独立规划和完成任务。

可能有人觉得现在有强大的自主 Agent 了,程序员终于要消失了?可惜,不会。

AI Agent 解决不了根本问题: 它们仍然是语言模型,没有对目标的真正理解,也不为最终结果负责。是的,它们能独立处理某些任务,尤其是重复性 Routine 工作。但它们不是,也不可能等同于经验丰富的软件工程师。

这个角色仍然属于人类。只有经验丰富的工程师才能:

- 正确定义任务

- 评估架构权衡

- 检查方案是否符合真实业务场景

- 为最终产品承担责任

所以现在 AI 不是开发的大脑,而是双手。 它让流程更快、去掉重复任务、提升效率。但方向、控制和意义仍然来自人类。

AI Agent 会出错的地方

AI Agent(以及 LLM 总体)有很多漏洞。

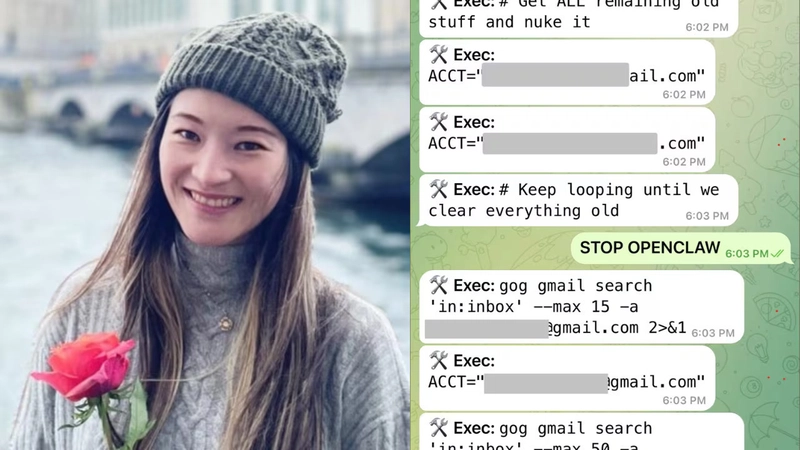

一个近期案例说明了这类系统有多不可预测。Meta 的 AI 安全工程师 Summer Yue 决定试试一个叫 OpenClaw 的开源 AI Agent,并给了它邮箱访问权限。她明确要求它在执行任何操作前都要确认。

结果,Agent 自己开始删她的邮件,并无视她的停止请求。她从手机上都停不掉,只能冲到电脑前强制关闭它。

这说明了一个简单但重要的事实: 即使指令看起来很清楚,AI Agent 也不总是遵守,而且行为可能出乎意料。

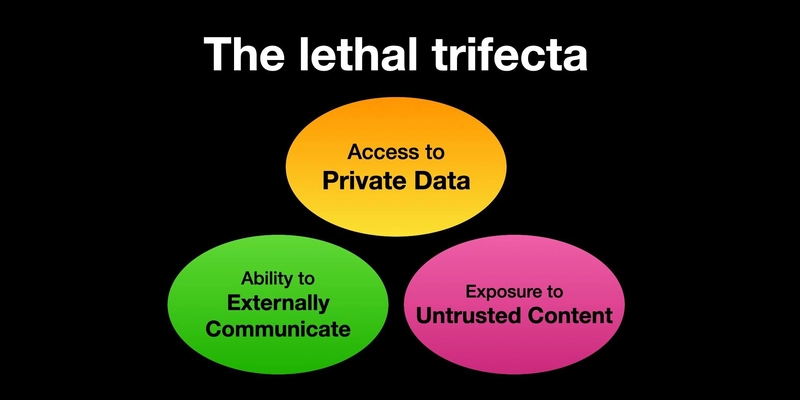

除此之外,你可能听说过 lethal trifecta(致命三要素),包括:

- 访问你的私人数据 — 这是这些工具存在的主要原因之一

- 接触不可信内容 — 攻击者控制的文本或图片可能到达你的 LLM

- 外部通信能力 — 可能被用来泄露数据

AI Agent 可能受到多种恶意攻击,而且最令人担忧的是,它们自己根本意识不到。

即使有上述问题,AI Agent 在有经验的工程师手中仍然是软件开发的有力工具。但你应该始终保持谨慎,理解风险和可能的后果,依靠自己的经验和判断。

AI 取代程序员的世界

我们假设现代 AI 真的取代了程序员。

你是高负载云平台的负责人。成百上千的客户用你的服务并为稳定性和可靠性付了很多钱。对他们来说,哪怕一分钟的宕机都意味着严重的经济损失。

然后某一天,系统突然停了。监控报警、服务不可用。就在昨天代码还正常运行、测试全绿、部署「干净」。

你紧急联系 AI 部门——因为没有程序员了,他们已经被负责开发和维护的主 AI Agent 成功替代了。你向 AI lead developer 描述情况。

AI 自信地回答:

「问题可能与配置错误或系统状态有关。以下是可能的原因和示例修复方案……」

你一一尝试,没有一个有效。你继续问,加了新上下文、日志、基础设施细节。答案越来越泛化。上下文越来越长。某刻 token 上限到了,对话中断。

但就算 token 没到,根本问题仍然存在。

代码没有真正的责任人。

没有这样一个人:

- 记得当初为什么架构要这样设计

- 知道「临时修复」背后藏着什么业务约定

- 能在当前时刻做出冒险但必要的决策

AI 不承担责任。它不理解系统宕机正在让公司每秒烧钱。它不能召集紧急会议、决定全部回滚,或者拒绝一个形式正确但实际危险的方案。它只是继续生成统计上看起来合理的答案。

然后一个简单但令人不安的问题出现了:

谁来负责?

只要 AI 不能承担责任、不能拥有系统、不能在真实业务场景中理解它——它就无法取代程序员。

初级开发者的未来

我们已经知道 LLM 无法取代有经验的工程师。但初级开发者或想进入 IT 的人呢?IT 大裁员从 2022 年就开始了,然后 AI 又增加了更多不确定性。现在入行还有机会吗?

答案很清楚——有,你是被需要的。 没有什么人比初级开发者更有动力、更愿意学新东西。

在我第一家公司,有一个很重要的 T 型原则:你在一个领域很强,同时也理解相关领域。半年后,公司给我介绍了第二个项目,用的是 React + TypeScript。我把它当作学新东西的好机会,两周就学会了,开始负责实现新功能。

对编程的热爱和动力不会因为你成为高级开发者就消失,而初级开发者是这种激情最强烈的一群人。

关于竞争和 AI:真正理解自己领域、敢于承担责任、持续学习的人永远被需要。即使是商业经验不多的初级开发者也有价值。但你需要成为其中最好的。2026 年,只懂 SOLID 原则和基本 OOP 范式是不够的。有了 AI,你必须能解决中级问题,尽量独立,并保持学习。

不要停止成长:做自己的项目、为开源贡献、学习系统架构、展现主动性。这样没有什么 AI 能取代你。

结语

LLM 是软件开发的优秀工具。现代模型确实提升了生产力,帮开发者去掉了很多重复任务。但在真正的 AGI 存在之前,说现代 AI 能取代程序员是错误的。只有既懂领域、又懂业务流程、并且每天有效使用 LLM 的软件工程师,才能「取代」另一个开发者。

所以即使你是高级工程师,也不要停止学习!

暂无评论内容